9.2 KiB

A2J:Anchor-to-Joint Regression Network for 3D Articulated Pose Estimation from a Single Depth Image

目录

- 目录

- A2J介绍

- [A2J模型简述](##1.1 A2J模型简述)

- [Anchor-to-Joint解析](##1.2 Anchor-to-Joint解析)

- A2J模型说明

- 数据集

- A2J模型训练和测试

- 环境配置要求

- 代码结构及功能说明

- 程序运行说明

- 测评结果以及结果可视化

- 改进措施

- 参考资料

#1. A2J介绍

##1.1 A2J模型简述:

该篇文章发布于2019年的ICCV,并获得了2019年hand pose挑战赛第一名的成绩。

- 本文针对深度图像中的三维手和人体姿态估计问题,提出了一种具有端到端学习能力的基于锚的联合回归网络(A2J)方法。

- 在A2J中,能够捕获全局局部空间上下文信息的锚定点被密集地设置在深度图像上,作为关节的局部回归。它们有助于以集成方式预测关节的位置,提高泛化能力。

- 提出的三维关节姿态估计方法不同于基于FCN、3D-CNN和基于点集的编码器-解码器。

- 为了发现指向某一节理的信息锚定点,该文章提出了A2J的锚点建议程序,同时采用二维CNN(即ResNet-50)作为骨干网络驱动A2J,而不使用耗时的三维卷积或反卷积层。

论文地址: https://arxiv.org/abs/1908.09999.

##1.2 Anchor-to-Joint解析:

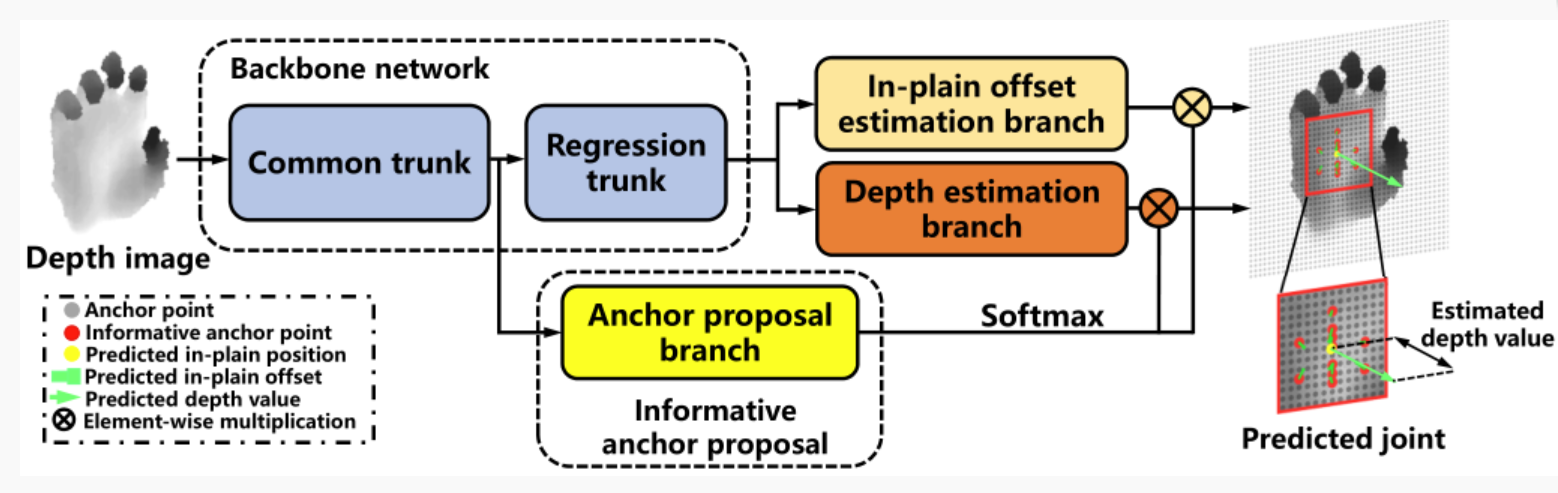

首先给出两张paper中的示意图。左图是技术方案的一个流程示意,

- 对于一张给定的输入深度图片(这里假设输入仅包含单个手或人体,前面需要一个检测器的预处理步骤,类似于human pose的Top-down思路),

我们密集的在图像上设立anchor point,如右图所示,每隔stride=4个像素点就会设立一个anchor point,

最终的关节点预测将会通过这些anchor point去完成。 - 具体而言,每个锚点需要针对所有关节点预测一个图像坐标下的偏移量(左图中的绿色箭头)以及一个深度值,

最终的关节点坐标将由所有锚点加权投票得出

(权重是可学习的,左图中红色的anchor point就是权重值比较大的点,称之为informative anchor point)。

2. A2J模型说明

2.1 A2J基本架构

- 作者认为每个anchor point对每个关键点坐标贡献都应程度并不一致,所以最后就是求所有anchor points 对每个关键点坐标求加权和,

为了实现上面的思路,采取的技术流程如下图所示。

-

A2J网络由3个分支组成,由2D-CNN 骨干网驱动。这3个分支分别负责预测锚点与节点之间的平面偏移量、估算节点深度值和提供锚点候选信息。

-

Backbone在实验中主要基于ResNet50,输出包含三个分支,一个是图像坐标系下面的偏移量输出,一个是深度值输出,最后一个是对anchor point进行加权的anchor proposal分支输出。

第三支的输出结果经过softmax之后直接乘在前面两支的输出结果上对anchor point投票进行权重赋值。

2.2 backbone结构

上面提到Backbone基于ResNet来提取特征,事实上作者对ResNet的结构进行了一些小的调整,使得最终编码得到的特征是经过16倍下采样的(而不是32倍)。

2.3 偏移量和深度预测分支

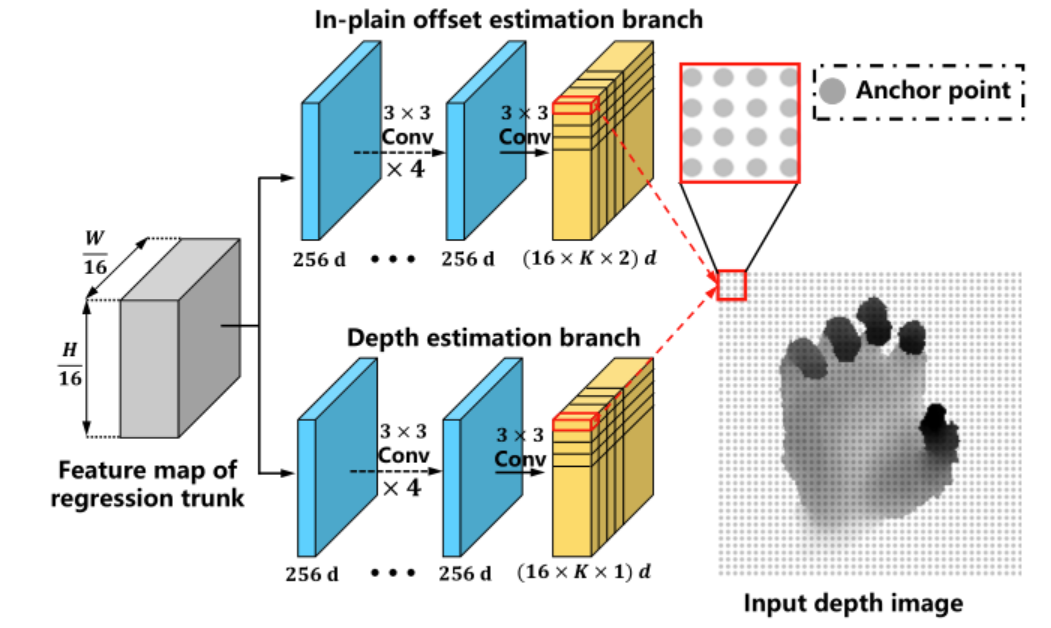

本质上,这两个分支旨在预测关节的三维位置。它们都包含4个256通道的中间卷积层,以及1个输出卷积层。

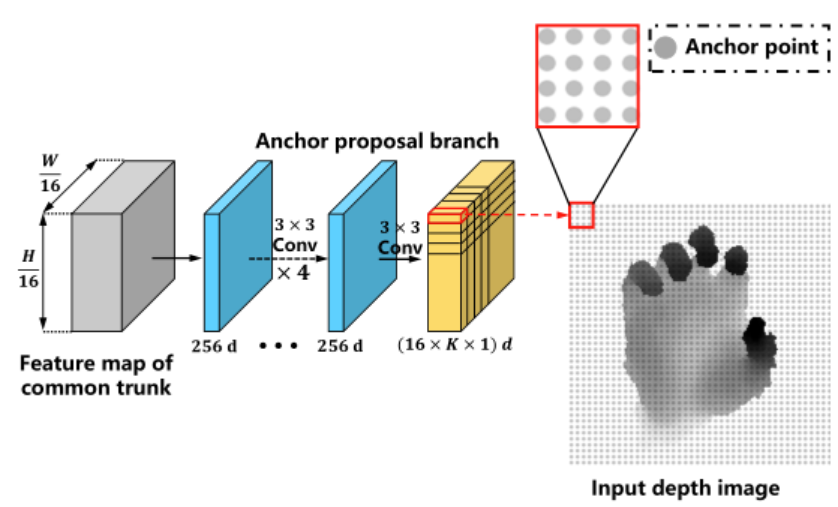

2.4 Anchor权重分支

该分支通过权重分配发现特定关节的信息性锚点,锚候选分支建立在骨干网内公共主干的输出特征图上,涉及较细的特征。

2.5 A2J损失函数

对于损失函数的选择,我们使用SmoothL1作为距离衡量标准,最终的损失包括loss1和loss2两项。

- loss1用于衡量预测值与GT之间的差异,在A2J中,锚定点作为局部回归量,以整体方式预测节理的三维位置

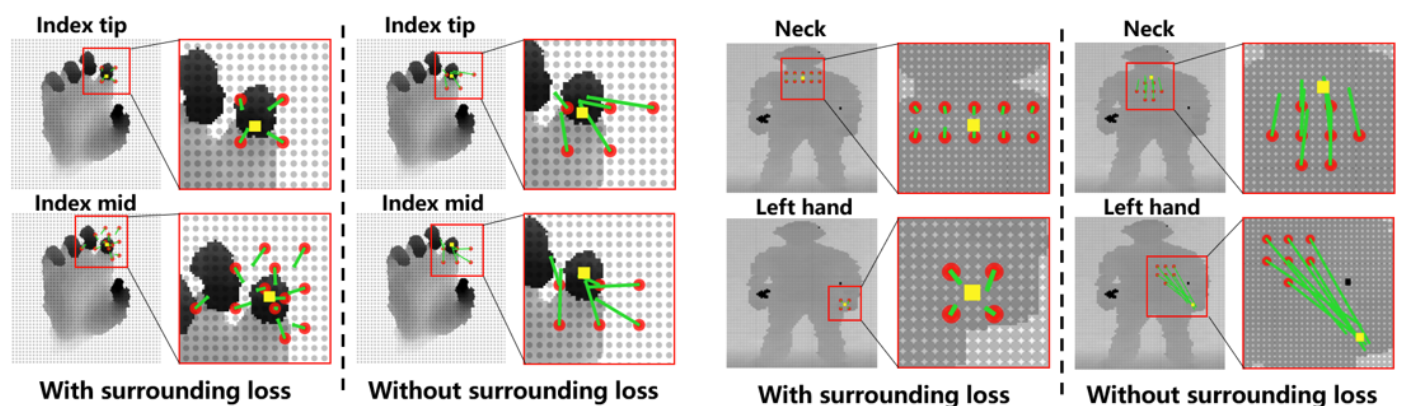

- 作者称loss2为Informative anchor point surrounding loss,这个loss的意义在于控制Informative anchor point的空间分布,

希望最终的Informative anchor point可以从关节点的各个角度去观察预测,进而加以下面的约束。

loss2实际是上是一个正则项,可以有效地缓解过拟合现象,最终的效果也非常显著,

如下图所示,有无loss2的时候Informative anchor point的位置分布差异很大:

最终的损失如下,其中lamda是平衡损失1和损失2的权重因子:

3. 数据集

hand pose dataset:

NYU_part

- 训练集:包含3000个样本,大小均为[128,128],每个样本有14个关键点的坐标[x,y,z]

- 测试集:包含1000个样本,大小均为[128,128],每个样本有14个关键点的坐标[x,y,z]

4. A2J模型训练和测试

4.1 A2J模型训练

- 通过在深度图像上密集设置A2J内的锚点,获取全局-局部空间上下文信息,集成预测关节位置。

- 每一次训练计算真实位置、深度与预测结果的损失值,将各种损失进行加和得到最终的损失,逐步迭代更新预测关节的位置和深度。

4.2 A2J模型测试

- 利用预先训练好的模型权重来对测试集进行预测,计算测试计算指标。

- 在NYU-hand数据集上使用平均关节误差(MJE)作为评估标准。

5. 环境配置要求

硬件(支持CUDA的GPU)

使用支持CUDA的GPU处理器来搭建硬件环境

##深度学习框架

Pytorch 1.12

##相关功能包

numpy 1.23

torchivision 0.13

opencv-python 4.5.4.36

PIL 4.3

6. 代码结构及功能说明

A2J

├─README.md

├─fig # README使用图片

├─NYU_part # 数据集

├─label_test.npy # 测试集

└─label_train.npy # 训练集

├─result

├─pretrained.pth # 模型权重文件

├─train.log # 训练日志

└─visual_result.jpg # 可视化结果

├─src

├─anchor.py #锚点的初始化、变换并加之loss的定义

├─attention.py #注意力机制(CBAM模块)

├─dataset.py #数据集定义、读取、预处理

├─model.py #A2J模型

├─random_erasing.py #随机选择图像中的矩形区域并模糊其像素

├─resnet.py #resnet作为backbone

└─transforms.py #自定义图像增强操作

├─test.py #测试

├─train.py #训练

└─visualize.py #可视化

7. 程序运行说明

7.1 训练过程

(1) 首先在train.py中修改数据集的地址以及相关参数

(2) 运行train.py

(3) 生成的模型权重会保存在result文件夹中

7.2 测试过程

(1) 运行test.py文件进行测试

(2) 运行visualize.py文件进行结果可视化

8. 测评结果以及结果可视化

8.1 MJE指标

在测试过程,指标选用Mean Joint Error

最终测试集上的测评结果: MJE=0.136

(运行test.py或visualze.py可得到)

8.2 结果可视化

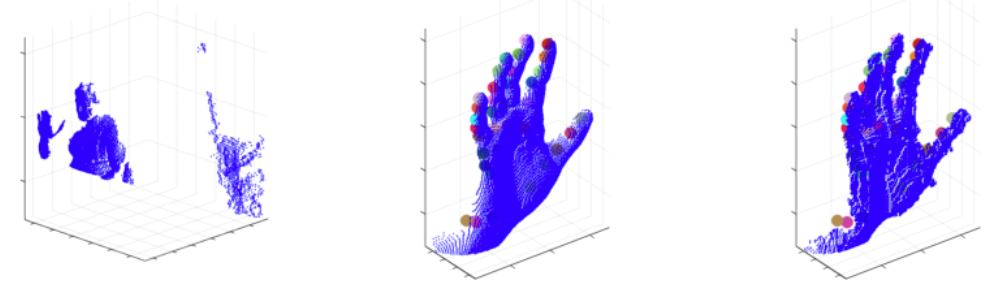

在测试过程的测试结果可视化如下图(部分结果):

其中红色为真实结果,黄色为预测结果

9. 改进措施

- 给网络多个分支加入注意力机制(CBAM模块),能让模型进一步提取有用特征信息

- 训练过程加入了数据增强:随机旋转、随机模糊,

(未加入水平翻转,因为经过实验验证该方法引起效果变差,可能原因是引入过量噪声导致模型训练效果差) - 修改了训练过程的batch size、学习率、weight decay:

具体是减小了batchsize,减小学习率,增大weightdecay,改善原因可能是增大了输入数据、模型训练的不确定性,改善了模型的鲁棒性 - 修改了损失函数权重:

具体是提高了回归损失的比例,

因为在训练过程当中损失值主要是分类损失占大多数,回归损失占小数,

这个做法使得模型训练过程更加均衡